AI-инструменты для исследований и контента: Elicit, Perplexity, NotebookLM и Napkin

Как искать и проверять научные данные через ИИ: Elicit, Perplexity, NotebookLM для исследований и Napkin.ai для визуализации. Личный опыт и пошаговый процесс.

Обновлено: 16 апреля 2026 г.

Несколько месяцев назад я полез разбираться с темой сна. Не потому что плохо сплю, а потому что заметил странную штуку. Куда ни ткни — везде говорят одно и то же: хочешь хорошую кожу — высыпайся, хочешь восстанавливаться после спорта — высыпайся, хочешь быть эмоционально стабильным — ну, ты понял. Классический эффект Баадера-Майнхоф: начинаешь замечать одну тему повсюду.

И тут я подумал: а что, если специально найти исследования, которые опровергают эту картину? Не статьи из блогов, а настоящие научные публикации. Звучит просто, но вручную это часов на десять минимум. С ИИ-инструментами получилось сильно быстрее. Заодно нашёл удобный сервис для визуализации результатов. Про весь процесс и расскажу.

Главное

- Elicit, Perplexity и NotebookLM закрывают три этапа работы с научными источниками: поиск, получение полных текстов и глубокий анализ.

- Napkin.ai автоматически превращает текст в схемы, диаграммы и инфографику за минуту.

- Все эти инструменты активно обновляются, поэтому конкретные функции и интерфейс могут отличаться от описанного.

- ИИ ускоряет рутину, но не заменяет критическое мышление — выводы делаешь ты сам.

Зачем проверять научные данные через ИИ?

Когда пишешь статью или готовишь презентацию, хочется опираться не на пересказы пересказов, а на первоисточники. Проблема в том, что искать научные статьи вручную — занятие на любителя. Google Scholar выдаёт тысячи результатов, половина за пейволлом, абстракты написаны языком, от которого хочется закрыть вкладку.

ИИ-инструменты не заменяют критическое мышление, но здорово ускоряют рутину: найти, отфильтровать, суммировать. Я не учёный и не претендую на академическую строгость. Но когда пишу про сон или привычки, хочется хотя бы понимать, на чём основаны рекомендации. И не транслировать мифы, которые гуляют из статьи в статью.

Как найти научные источники: три инструмента

Для поиска научных статей я использую три инструмента. У каждого своя сильная сторона, и универсального рецепта не существует — зависит от задачи.

Elicit — для работы с абстрактами

Elicit заточен именно под научные исследования. Вводишь запрос — например, «недостатки монофазного сна» — и получаешь таблицу с релевантными статьями. Каждая строка содержит суммированный абстракт и оценку того, насколько статья отвечает на твой вопрос. Не нужно открывать каждую публикацию, чтобы понять, подходит она или нет.

Отдельный плюс — Elicit умеет работать с описаниями статей, даже если полный текст за пейволлом. Ты видишь картину шире, чем если бы искал только среди открытых публикаций.

Perplexity — для быстрого обзора темы

Perplexity с функцией DeepResearch хорош для первого погружения. Он ищет по научным базам и выдаёт структурированный ответ со ссылками на источники. Ограничение: Perplexity работает в основном с теми статьями, которые полностью в открытом доступе. Картина может быть неполной, но как отправная точка — отлично.

DeepSeek и другие LLM — для уточняющих запросов

Иногда полезно закинуть найденные данные в DeepSeek или ChatGPT и попросить докрутить запрос, переформулировать гипотезу или найти смежные темы. Это не замена специализированным инструментам, а скорее помощник для итерации.

На этом этапе по теме сна я нашёл 12 статей: часть про недостатки монофазного сна, часть про пользу бифазного, в том числе на примере средневековых обществ. Неплохой улов для пары часов работы.

Где взять полные тексты статей

Нашёл абстракты — теперь нужны полные тексты. Тут всё проще, чем кажется. Берёшь название статьи, добавляешь «pdf» и ищешь через Google. В большинстве случаев полный текст находится. Иногда помогает ChatGPT или DeepSeek — они могут подсказать альтернативные источники.

Если есть университетская почта — шансы выше, многие журналы дают доступ через институциональную подписку. Если нет, иногда приходится искать другую статью без пейвола. Это нормально: не каждая публикация обязана быть доступна бесплатно.

Из 12 найденных абстрактов я получил полные тексты 11 статей. Один потерялся — с этим можно жить.

Анализ источников в NotebookLM

Вот тут начинается самое интересное. NotebookLM от Google — это, по сути, ИИ-исследователь, который работает только с теми документами, которые ты ему загрузил. Никаких галлюцинаций из интернета — только то, что лежит в твоей библиотеке.

Процесс простой: загружаешь PDF-файлы статей, задаёшь вопросы, сохраняешь заметки. Повторяешь, пока не соберёшь достаточно данных для понимания темы. Результат можно оформить в статью, серию постов или просто оставить как базу знаний для себя.

Что мне нравится в NotebookLM — он цитирует конкретные места из загруженных документов. Ты видишь, откуда взят каждый факт, и можешь перепроверить. Это принципиально отличает его от обычного чата с LLM, где источник ответа часто непрозрачен. По той же причине в академической среде к обычным LLM относятся с осторожностью: они склонны к галлюцинациям — уверенно звучащим, но ничем не подкреплённым ответам.

По итогам анализа я понял: польза сна неоспорима, но формат сна можно адаптировать. Есть исследования, которые показывают пользу бифазного сна для сердечно-сосудистой системы. Правда, там скорее корреляция, чем причинно-следственная связь. Но само наличие таких данных меняет картину — не всё так однозначно, как пишут в популярных статьях.

Визуализация результатов: Napkin.ai

Когда данные собраны, их хочется оформить. Для статей и презентаций нужны визуализации, а рисовать схемы вручную — отдельный навык и отдельное время. Здесь пригодился Napkin.ai.

Принцип работы: вставляешь текст, и сервис автоматически вычленяет суть по абзацам. На каждый абзац предлагает до 20 вариантов визуальных форматов — схемы, диаграммы, карточки, таймлайны. Абзацы можно объединять, чтобы получить обобщённую визуализацию. Любую картинку можно кастомизировать: цвета, шрифты, расположение элементов.

Готовые визуализации экспортируются в разных форматах. Для блога подойдёт PNG или SVG, для презентации — вектор. Первый результат получается буквально за минуту. Для серьёзной инфографики, конечно, нужна доработка, но как стартовая точка — быстро и удобно.

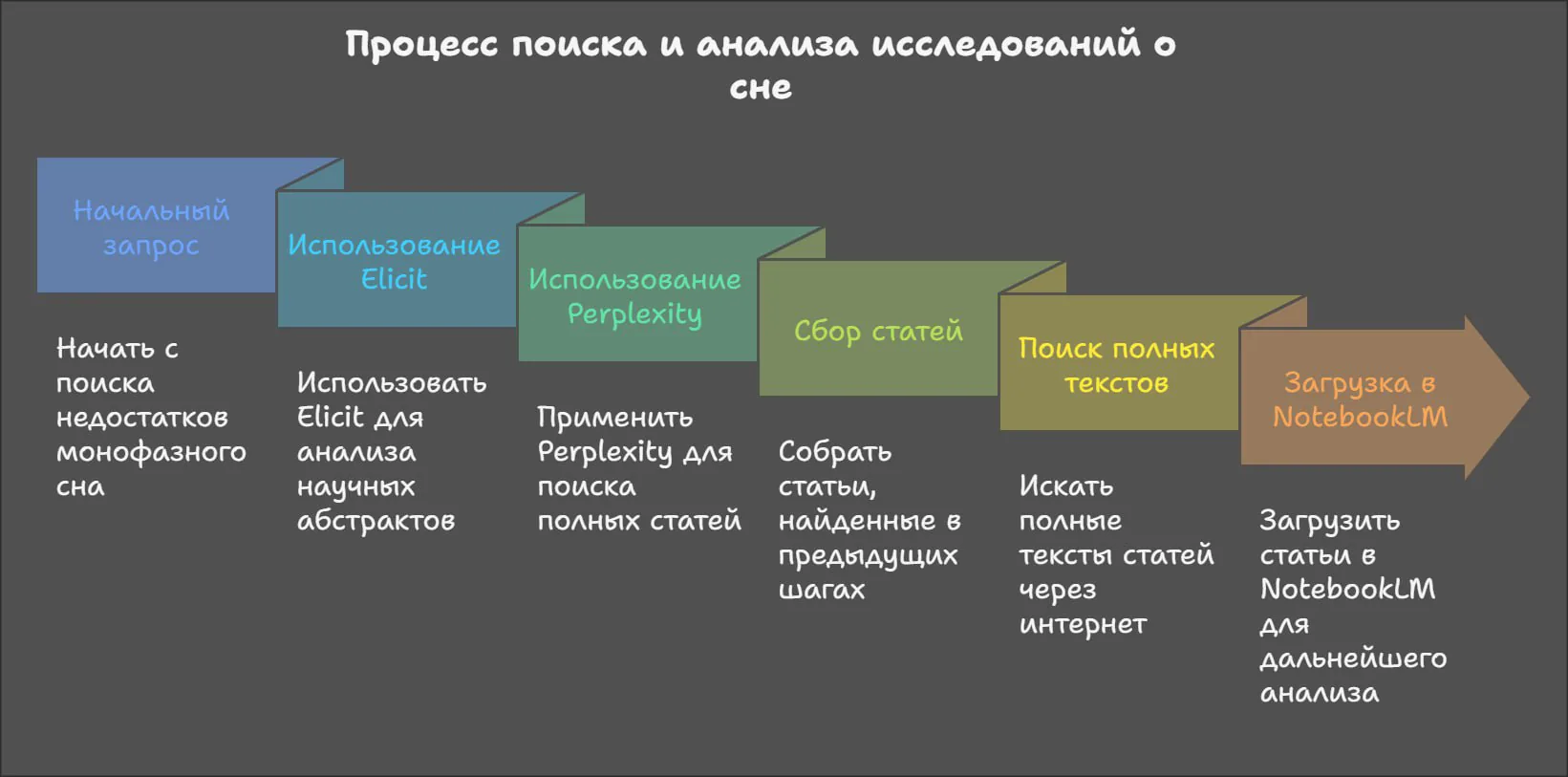

Как выглядит весь процесс

Если собрать всё вместе, получается четыре шага:

- Поиск источников через Elicit и Perplexity — формулируешь запрос, собираешь релевантные абстракты.

- Получение полных текстов — ищешь PDF через Google или с помощью LLM.

- Глубокий анализ в NotebookLM — загружаешь статьи, задаёшь вопросы, фиксируешь выводы.

- Визуализация через Napkin.ai — превращаешь текстовые выводы в схемы и диаграммы.

Каждый инструмент закрывает свою задачу. Ни один из них не делает всё сразу, но вместе они дают рабочий пайплайн. Раньше на подобное исследование ушла бы неделя. Сейчас — пара вечеров.

Что стоит учитывать

Все перечисленные инструменты активно развиваются. Интерфейсы меняются, функции добавляются и убираются, условия доступа обновляются. То, что я описал, работало на момент моего эксперимента. К моменту, когда ты это читаешь, что-то наверняка изменилось. Так что воспринимай статью как отправную точку, а не как пошаговую инструкцию с гарантией.

И здесь возникает важный момент: ИИ ускоряет рутину, но не заменяет критическое мышление. Найти 12 статей — полдела. Понять, что в них корреляция, а не причинно-следственная связь, — это уже твоя работа. Серебряной пули нет. Инструменты дают доступ к данным, но выводы делаешь ты сам.

Если тебе интересна тема продуктивности с помощью технологий, или ты уже собираешь данные о себе через Quantified Self, эти инструменты хорошо встраиваются в такой подход. Не как серебряная пуля, а как ещё один слой в системе работы с информацией.

Часто задаваемые вопросы

Заменяют ли ИИ-инструменты научный поиск в Google Scholar?

Нет. Elicit и Perplexity надстраиваются над теми же базами (PubMed, Semantic Scholar, arXiv), что и Scholar, но быстрее фильтруют и саммаризируют результаты. Для системного литературного обзора Scholar всё ещё нужен — он шире индексирует и даёт полные списки цитирований. ИИ-инструменты выигрывают на этапе «просеять 200 абстрактов за час».

Можно ли доверять суммаризации абстрактов от ИИ?

Для первичного отбора — да, для финальных цитат в статье — нет. Саммари от Elicit и NotebookLM хорошо показывают, о чём статья, но любая конкретная цифра или вывод должны быть перепроверены по оригиналу. Это та же гигиена, что и с критическим мышлением при работе с информацией.

Что делать, если полный текст статьи за пейволлом?

Три рабочих пути: поиск препринта на arXiv или Semantic Scholar, запрос через сервис вроде Unpaywall, письмо автору статьи напрямую (многие охотно присылают PDF по email). Если ничего не сработало — ищите следующую статью по той же теме: в большинстве случаев альтернатива находится.

NotebookLM бесплатный?

На момент написания — да, с ограничениями на количество источников и заметок в рамках бесплатного тарифа Google. Условия могут меняться — проверяйте в документации перед серьёзной работой. Мой опыт: для разбора 10–15 статей бесплатного тарифа хватает с запасом.

Не опасно ли собирать исследования через ИИ — он же может соврать?

Опасно, если использовать LLM общего назначения (ChatGPT, Claude) для поиска фактов без источников — они действительно галлюцинируют. Elicit, Perplexity и NotebookLM устроены иначе: они всегда показывают первоисточник. Правило простое: если инструмент не даёт ссылку на проверяемую статью — относитесь к ответу как к гипотезе, не как к факту.